Voici quelques articles et publications présentant des mises en application musicologiques des outils d’analyse développés dans le cadre du projet ARS :

- Céline Chabot-Canet, Yann Teytaut, Axel Roebel. ‘La voix d’Aznavour : épiphanie de l’imparfait’. Chanson et poésie. Hommage à Charles Aznavour, Université Paris Sorbonne, Jun 2024, Paris Sorbonne Université, France. Publication des actes en cours. ⟨halshs-04808745⟩

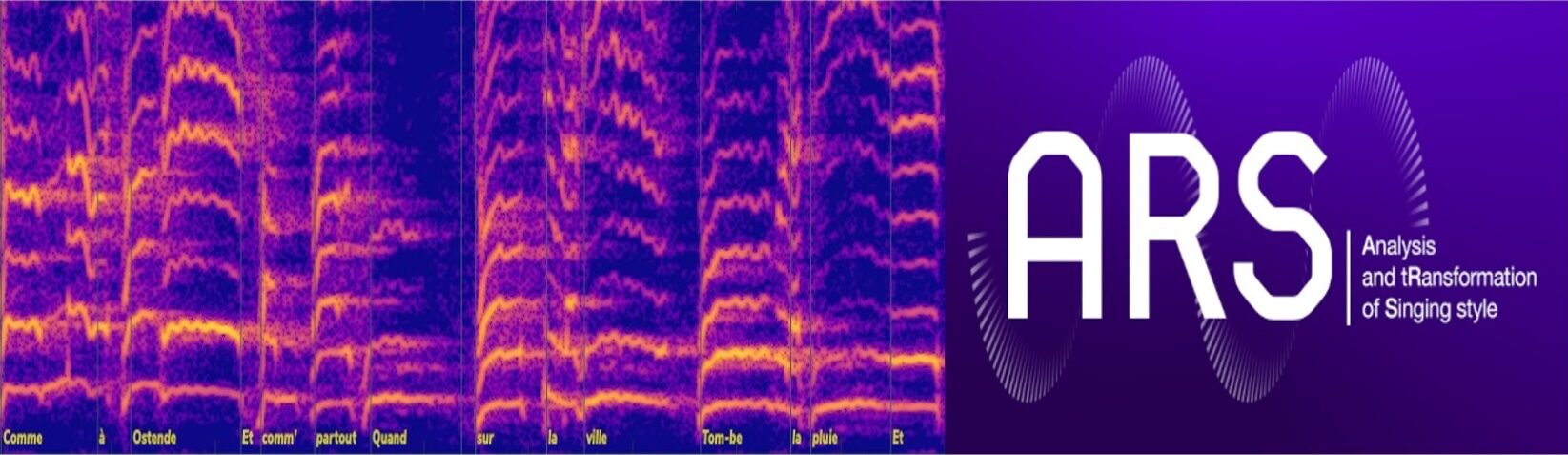

- Céline Chabot-Canet. Analyse comparative du style de chant dans quelques interprétations de « Comme à Ostende » (Jean-Roger Caussimon / Léo Ferré). Des chansons dans tous les sens : Chanter l’Europe, Les Ondes du Monde; Aix Marseille Université, May 2024, Aix-en-Provence, France. ⟨halshs-04808815⟩

- Céline Chabot-Canet. « L’interprétation de Barbara : l’expressivité de l’infime dans la performance vocale », Sébastien Bost, Catherine Douzou, Barbara en scène(s) : Une femme, une œuvre en performance, Presses Universitaires de Provences, 2022, p.105-130. ⟨halshs-04809588⟩

- Yann Teytaut, Antoine Petit, Céline Chabot-Canet, and Axel Roebel. « A musicological pipeline for singing voice style analysis with neural voice processing and alignment ». In Journées d Informatique Musicale (JIM 2023), Saint-Denis, 2023. En ligne : https://jim2023.sciencesconf.org/data/pages/7_1_TEYTAUT_ET_AL.pdf

Démonstration dans le cadre colloque international « Nouvelles Perspectives d’analyse musicale de la voix », Lyon, 20-21 juin 2024

Session ARS 1 : A Deep Learning-Based Pipeline for the Musical Analysis of the Voice – Antoine Petit, Yann Teytaut, Axel Roebel, Céline Chabot-Canet

Résumé

While the musical analysis of the singing (or rapping, chanting, etc.) voice is becoming more widespread by the day, it very much remains a daunting task. Data is required if one wishes to go beyond a purely impressionistic account of the voice; text must be aligned with the recording, and various measurements be made. The absence of automatic analysis tools for voices recorded in a “real” musical context (i.e., commercial recordings featuring instrumental accompaniment, as opposed to solo voice corpora produced specifically for research) has led to tedious, predominantly manual annotation work—a time-consuming process which limits analytical prospects to individual case studies. Recent developments in deep learning-based signal processing have brought about promising alternatives, and theorists have already started to incorporate such technologies as source separation (informally known as “demixing”) into their methodologies. Large-scale corpus studies can thus be more readily envisioned, and innovative approaches are being devised which make use of accurate parameter extraction from isolated vocals. Building on a long-term collaboration between music theorists on the one hand, and signal processing researchers on the other, one of the goals of the ARS project has been to develop an enclosed pipeline that takes advantage of these novel tools without having to rely on multiple unrelated, and often repurposed, pieces of software, which can make analytical methodologies less accessible, and less reproducible. The proposed system includes state-of-the-art source separation and fundamental frequency estimation models trained specifically for the voice, and a voice-to-symbol synchronization algorithm that performs text (or note) alignment independent of any prior domain knowledge—that is, irrespective of the target language, musical genre and style, etc. The different modules can be accessed through an online interface, to ensure ease of use.

Session ARS 2 – Analyse performative du style vocal – Xiao Xiao, Boris Doval, Céline Chabot-Canet, Christophe d’Alessandro

Résumé

Le « style vocal » se rapporte aux caractéristiques particulières d’une performance, au-delà des paramètres de la composition musicale et du matériau textuel de la chanson. Comprendre le style consisterait à caractériser la manière de faire propre à un ou une artiste ; ce qui, à la fois, l’inscrit dans un courant spécifique et, au sein de ce courant, la distingue et la singularise entre toutes. Le style échappe à la notation et englobe la personnalité vocale et la dynamique particulière d’une performance : qualité vocale, gestes articulatoires, transitions de notes, effets de vibrato, de glissando ou de tremolo, agogique, etc. Pour l’auditeur non spécialiste, ce qui définit le style d’un chanteur est souvent perçu de manière intuitive et difficile à objectiver, bien qu’essentiel dans son ressenti à l’écoute d’une voix. Voks est un « instrument chanteur », un synthétiseur vocal performatif qui permet de « jouer » une voix avec les mains. La mélodie, le rythme, l’effort vocal d’une séquence de voix préenregistrée sont contrôlés par un thérémine ou une tablette graphique et un capteur rythmique. Dans cette communication, nous mettrons Voks à l’épreuve de la reproduction du style vocal. L’approche instrumentale permet alors d’établir un pont unique entre une perception et une compréhension intime d’un style vocal singulier et son explicitation à travers le geste, dans un paradigme d’analyse par la synthèse performative. Dans cette communication, l’analyse performative, en dialogue avec l’analyse a posteriori et l’analyse paramétrique du style, étudiera le style vocal d’« Il n’y a pas d’amour heureux », chanson de Georges Brassens, dans trois interprétations incarnant trois styles distincts : G. Brassens, Barbara et Françoise Hardy. Cette première étude de l’analyse performative du style vocal permettra d’évaluer par l’écoute la pertinence des phénomènes observés en insistant particulièrement sur la matérialité du style (par exemple les habitudes articulatoires et la qualité vocale d’un chanteur) et sur la nécessaire approche globale et interactive des gestes expressifs, quand l’approche analytique aurait plutôt tendance à considérer des paramètres séparés.